AI開発の最前線で、静かな、しかし根深い亀裂が走っている。

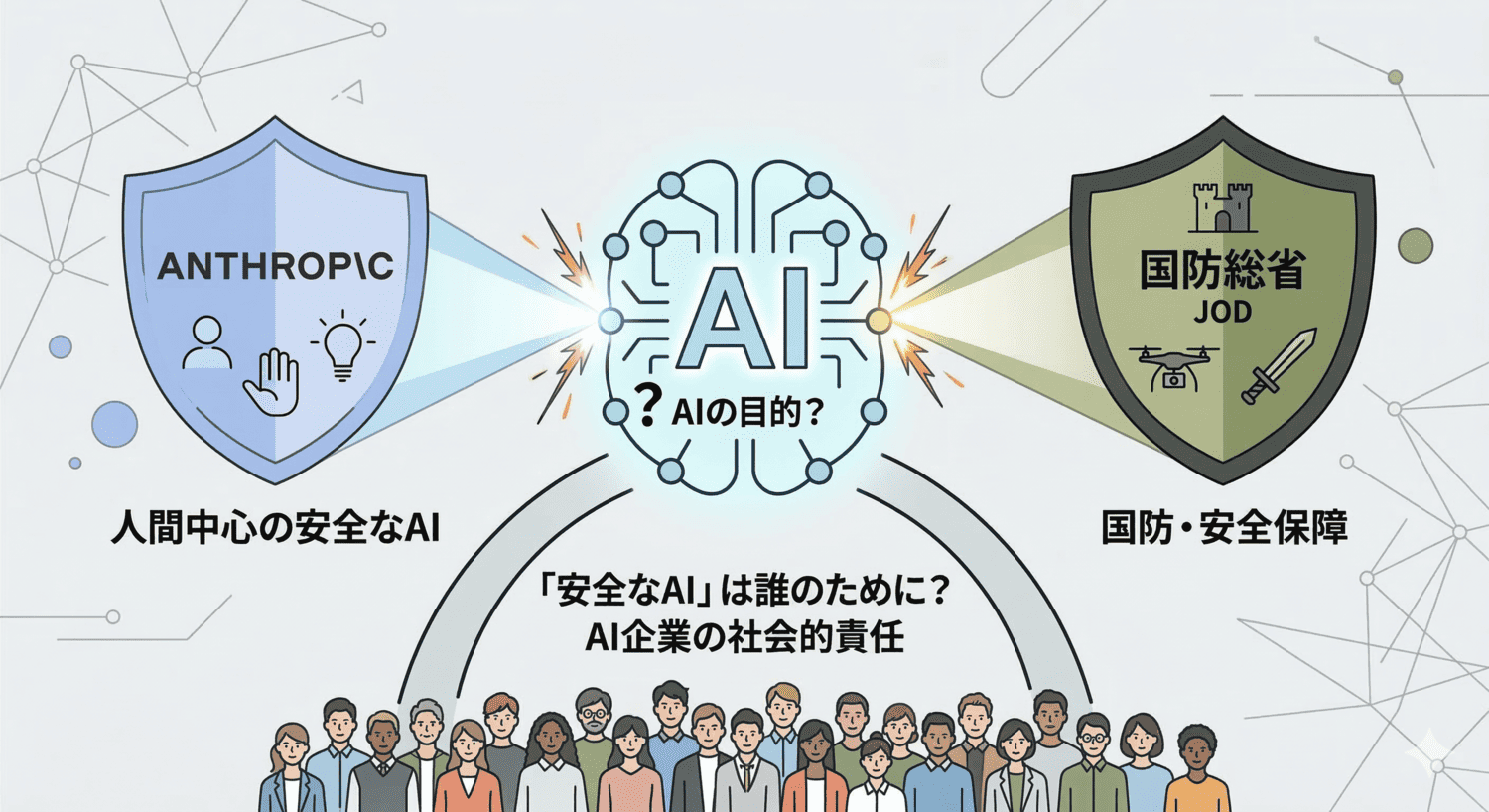

2024年末から2025年にかけて、AI安全性の旗手として知られる米アンソロピック社(Anthropic)と、米国防総省(DoD)との間で、AIの軍事・防衛利用をめぐる緊張関係が浮上した。「責任あるAI開発」を掲げる企業が、国家の安全保障という要請とどう向き合うべきか。この問いは、シリコンバレーと国防総省の間だけでなく、今やすべてのAI関連企業と社会全体が答えを迫られるテーマとなっている。

本記事では、この対立の背景と本質を読み解きながら、AI企業の社会的責任と政府との関係について考察する。

何が起きたのか——対立の構図

アンソロピックは、OpenAIの元幹部らが2021年に設立したAI企業だ。「AIの安全な開発」を企業理念の中核に据え、大規模言語モデル「Claude」の開発・提供を行っている。創業の背景にはAIのリスクへの強い問題意識があり、研究者コミュニティの中では「最も倫理的なAI企業のひとつ」として一定の評価を受けてきた。

一方、国防総省はAIを次世代の戦略的技術として位置づけ、2010年代後半から積極的な活用推進に動いてきた。自律兵器システムの開発、戦場情報の高度化、サイバー防衛など、AIの軍事応用領域は急速に拡大している。

この両者の間で生じた摩擦の核心にあるのは、「使用許諾条件」と「倫理的制限」の解釈をめぐる問題だ。アンソロピックは、Claudeの利用規約において、兵器開発への直接的な転用や、生命を脅かす行為の支援となる用途を禁止している。国防総省側からすれば、AIを安全保障目的で利用する際に、こうした制約が実務上の障壁となりうる。

この対立は単純な「善対悪」の構図ではない。倫理的なAI企業が軍事利用を拒んでいるという見方は一面的すぎる。アンソロピック自身、米国防関連の調達契約や政府向けの提供を完全に拒否しているわけではない。問題の本質は、「どの用途までが許容され、どこからが禁止されるべきか」という線引きの曖昧さと、その決定権が誰にあるのか、という点にある。

なぜ今、この問題が表面化したのか

この対立が今日特に鋭くなっている背景には、いくつかの構造的な要因がある。

生成AIの実用化の急加速

ChatGPTの登場以来、大規模言語モデルは「研究室の技術」から「現場で使えるツール」へと変貌を遂げた。国防総省も例外ではなく、兵站管理、文書作成、情報分析、教育訓練など、多様な非戦闘的業務にAIを活用し始めている。同時に、AIが戦闘判断や標的識別の補助ツールとして検討される動きも加速している。AIが「使えるもの」になればなるほど、軍はその能力を欲し、AI企業はその要請に応えるかどうかという選択を迫られる。

AIの「デュアルユース(二重用途)」問題の深刻化

核技術や化学物質と同様、AIも本質的に民間・軍事の両方に転用可能な技術だ。文章要約や翻訳、コード生成といった機能は、業務効率化にも、情報操作にも使える。「平和利用」と「軍事利用」の境界は、技術的には非常に曖昧だ。この曖昧さの中で、AI企業は規約による線引きをするほかないが、その線引きが国防総省のニーズと衝突する場面が増えてきた。

地政学的競争の激化

米国が中国との技術覇権競争を意識する中で、AI分野での主導権は単なる産業政策の問題ではなく、安全保障上の死活問題となっている。「中国がAIを軍事強化に使っている以上、米国も同様に進めなければならない」という論理は、政府内でも議会でも一定の説得力を持つ。アンソロピックのような企業にとっては、この「国家安全保障」という大義に対して、どう向き合うかという圧力が増している。

AI企業の「資金調達」構造の矛盾

アンソロピックはアマゾンやグーグルから巨額の投資を受けている。米国の主要IT企業群がすでに国防総省と深い取引関係にある以上、アンソロピックが「政府から切り離された純粋に安全志向の企業」であり続けることへのジレンマは大きい。資本の論理と倫理的立場の間で、企業として一貫したポジションを維持することの困難さが、この問題の複雑さを増している。

AI企業の「社会的責任」とは何か

「企業の社会的責任(CSR)」という概念は、もはやビジネス界に定着したが、AI企業にとってこの問いはより深く、より難しい。

アンソロピックが掲げる「安全なAI」とは、本来、AIが人間社会に与えるリスク——誤情報の拡散、偏見の強化、悪用による被害——を最小化するという哲学から生まれたものだ。この哲学が軍事利用の制限につながっているのは、ある意味で論理的な帰結だ。兵器の開発や戦闘指揮に関わるAIは、最悪の場合、人の命を奪う意思決定を下す可能性があるからだ。

しかし、ここで問われるのは、「誰にとっての安全か」という問いだ。

アンソロピックの立場からすれば、AIが不当な殺傷に使われないことが「安全」の定義に含まれる。一方、国防総省からすれば、AIを活用して敵の脅威を正確に把握し、味方の兵士の命を守ることも「安全」だ。同盟国の市民を守るためにAIが必要だという論理も、否定しきれるものではない。

この価値観の相違は、単なる意見の違いではなく、「誰が定義するのか」という権力の問題でもある。民間企業が独自の倫理観で国防という国家権限に制約を課すことは、民主主義的には正当化されうるのか。あるいは、政府こそがAIの用途を定め、企業はそれに従うべきなのか。

アンソロピックをはじめとするAI企業が採っているアプローチは、いわば「自主規制による先占」とも言える。法的規制が追いつく前に、企業自身が使用ルールを定め、社会的信頼を獲得しようとする戦略だ。この姿勢には一定の評価があるが、同時に批判もある。企業の倫理基準が民主的な検討プロセスを経ていない以上、それは「民間による統治」であり、説明責任が問われうる。

前例が示す教訓——グーグルとプロジェクト・メイブン

AI企業と国防総省の緊張関係において、最も有名な先例はグーグルの「プロジェクト・メイブン(Project Maven)」だろう。

2017年、グーグルは米国防総省のドローン映像解析AIプロジェクトに参画した。しかし2018年、社内の従業員約4,000人が「グーグルは戦争事業に関与すべきではない」との抗議書に署名し、プロジェクトへの継続参加を拒んだ。グーグルは最終的に同プロジェクトの更新を見送り、その後AI倫理原則を公表した。

この出来事が示すのは、三つの重要な教訓だ。

①従業員の価値観が経営判断を動かすという現実

AIエンジニアの多くは、自分の技術が人を傷つけることに使われることへの強い抵抗感を持っている。優秀な人材を維持するためには、彼らの価値観を無視できない。

②企業の方針表明だけでは問題は解決しないという点だ。

グーグルはAI原則を公表したが、その後も政府プロジェクトへの関与を完全に絶ったわけではなく、批判は続いた。原則と実践の乖離は、かえって信頼を損なう。

③「撤退」は必ずしも問題解決ではないという点だ。

グーグルが降りたプロジェクト・メイブンは、その後も別の企業によって継続された。AI企業が軍事プロジェクトから退くことで、より倫理的な競合に機会が渡るとは限らない。

アンソロピックが直面している問題も、この構造と本質的に重なる。「自分たちが関わらなければ、より危険なAIが使われるかもしれない」という逆説的なジレンマは、企業が倫理的な断固たる立場を取り続けることの難しさを示している。

この対立が示す未来の問い

アンソロピックと国防総省の緊張は、今後のAIガバナンスに対していくつかの根本的な問いを投げかけている。

AIの軍事利用を規律するルールは誰が作るべきか。

企業の自主規制、国内法、国際条約——それぞれに強みと限界がある。個々の企業が独自の規約を設けるだけでは、国境を越えた統一基準は生まれない。国際社会が「AI兵器」に関する共通の枠組みを構築できるかどうかは、核軍縮交渉に匹敵する難題だ。

「安全なAI」と「有効なAI」はトレードオフなのか。

制約が多いほど安全だが、使い勝手が悪くなる。制約が少ないほど有効だが、リスクが高まる。このトレードオフを乗り越えるためには、技術的な工夫(例えば用途を限定した特化型モデル)と制度的な枠組み(監査・検証の仕組み)の両輪が必要だ。

AI企業は「中立」でいられるか。

かつて「情報の民主化」を掲げたインターネット企業が、今や地政学の最前線に立たされているように、AI企業もまた中立でいることの難しさに直面している。技術の強大な力は、好むと好まざるとにかかわらず、政治・軍事の世界に引き込まれていく。

アンソロピックの事例は、「AI企業は純粋に技術と倫理だけを追求できる」という幻想が崩れつつある現実を映している。ビジネスパーソンとして、あるいは社会の一員として、私たちはAI企業に何を期待し、何を要求するのかを改めて問い直す必要がある。

まとめ:「誰の安全か」を問い続けることが出発点

アンソロピックと国防総省の対立は、AI時代の「価値観の衝突」を象徴する出来事だ。どちらの立場にも論理があり、どちらの主張にも聞くべきものがある。単純に「企業の良心が政府の横暴に立ち向かった」と読み解くのは、問題の複雑さを見誤ることになる。

重要なのは、この緊張関係を「他社の話」として傍観しないことだ。AIを活用するすべての企業・組織は、程度の差こそあれ、同様のジレンマに直面しうる。自社のAI活用において「どこまでが許容できる用途か」という問いを持つことが、これからのビジネスリーダーに求められる視点だ。

「安全なAI」とは技術の問題である以前に、価値観と意思決定の問題だ。それを誰が、どのプロセスで定めるのか——この問いへの答えを社会全体で模索し続けることが、AI時代の民主主義の試金石になる。

参考文献

- Anthropic(2023)”Anthropic’s Responsible Scaling Policy” https://www.anthropic.com/responsible-scaling-policy

- U.S. Department of Defense(2023)”Data, Analytics, and Artificial Intelligence Adoption Strategy” https://www.ai.mil/

- Shane, Scott & Wakabayashi, Daisuke(2018)”‘The Business of War’: Google Employees Protest Work for the Pentagon” The New York Times

- CNAS(Center for a New American Security)(2024)「AI and the Future of U.S. National Security」https://www.cnas.org/

- Future of Life Institute(2023)”Pause Giant AI Experiments: An Open Letter” https://futureoflife.org/open-letter/pause-giant-ai-experiments/

※本記事における対立の詳細な経緯・発言等は、公開情報をもとにした考察であり、当事者の公式見解を代表するものではありません。